Google modifica su política de IA y elimina restricciones sobre armas y vigilancia

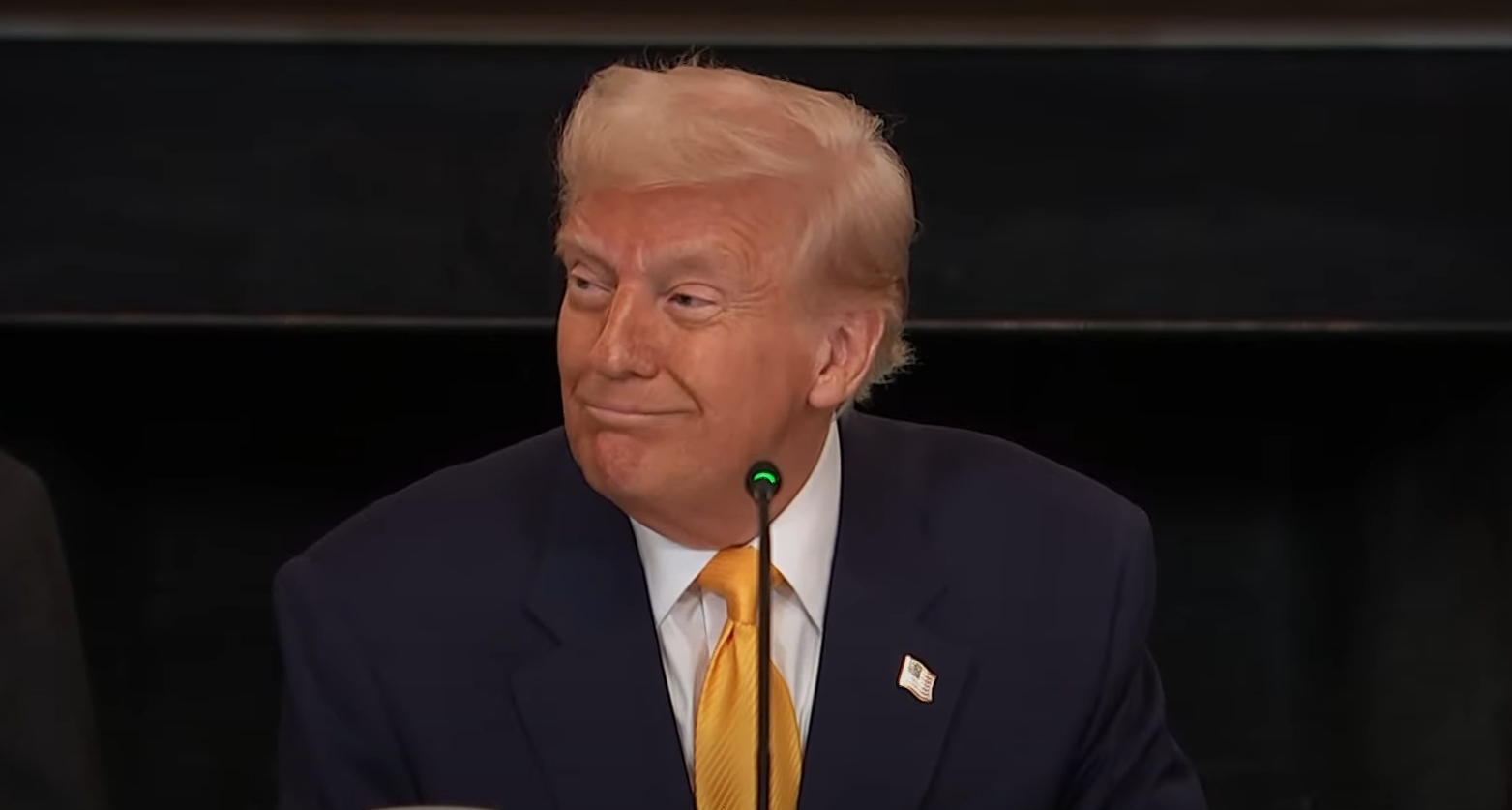

Sede central de Google en Mountain View

Google ha realizado un cambio significativo en su política de inteligencia artificial (IA), eliminando restricciones que anteriormente impedían el desarrollo de sistemas relacionados con armamento y vigilancia más allá de los estándares internacionales. Esta decisión marca un giro en la estrategia ética de la compañía respecto al uso de esta tecnología.

La actualización, publicada recientemente en el blog oficial de Google, subraya la importancia de que las democracias lideren el avance de la inteligencia artificial con base en principios como la libertad y el respeto a los derechos humanos. Sin embargo, la eliminación de restricciones previamente establecidas ha generado preocupación sobre las posibles implicaciones de este movimiento.

Desde hace años, Google mantenía un compromiso explícito de no utilizar su IA para desarrollar armas ni herramientas de vigilancia que excedieran ciertos límites éticos. No obstante, el panorama global de la inteligencia artificial ha evolucionado rápidamente, y la competencia tecnológica ha impulsado a las empresas a redefinir sus políticas.

Este cambio en la postura de Google refleja el creciente vínculo entre las grandes tecnológicas y el sector de defensa en Estados Unidos. Algunos analistas consideran que la actualización de su política es una señal de alineación con las nuevas realidades del mercado y los intereses estratégicos del país.

El debate ahora se centra en cómo las compañías tecnológicas pueden equilibrar la innovación con la responsabilidad ética. La decisión de Google reabre la discusión sobre los límites que deben establecerse en el desarrollo de la inteligencia artificial para evitar posibles riesgos en su aplicación.

Deja un comentario